Stellen Sie sich Ihren Namen als Haustür vor. Jedes Mal, wenn Sie die Straße fegen (Löschung beantragen), schiebt jemand neue, leicht veränderte Zettel unter der Tür durch. Sie räumen diese weg – und doch liegen am nächsten Morgen wieder Kopien da.

So ähnlich verhält es sich, wenn Betroffene gestohlene Intim-Fotos aus der Suche entfernen lassen wollen. Das Fegen steht hier für den Lösch- bzw. Auslistungsantrag nach Art. 17 DSGVO. Die neuen Zettel sind kerngleiche Varianten desselben Bildes – Crops, Spiegelungen, minimale Retuschen. Und die Haustür mit Ihrem Namen entspricht der Namenssuche, über die die Treffer wieder auftauchen.

Aktuell klagt eine Betroffene vor dem LG München I gegen Google. Ihr Ziel ist klären zu lassen, ob Google solche Inhalte nicht nur punktuell löschen, sondern dauerhaft identische und kerngleiche Varianten auslisten muss. Die Aufnahmen sollen durch Dritte aus einer Cloud entwendet worden sein und kursieren auf einschlägigen Seiten; teils mit Klarnamen, teils leicht verändert. Unterstützt wird die Klage von HateAid #NotYourBusiness als strategisches Verfahren. HateAid berichtet von rund 2.000 gemeldeten Suchtreffern binnen 18 Monaten; nach Entfernungen folgten immer wieder Re-Uploads.

Der Fall greift ein strukturelles Problem auf, die anhaltende Sichtbarkeit sensibelster Inhalte über Suchmaschinen.

Hinweis (Stand: Oktober 2025): Die Klage gegen Google ist seit September 2025 beim LG München I anhängig. Wir verfolgen das Verfahren und werden hier über wesentliche Updates informieren.

Inhalt

Worum geht es rechtlich?

Seit Google Spain (EuGH - C-131/12) ist klar: Der Suchmaschinenbetreiber ist für das Indexieren/Anzeigen personenbezogener Daten Verantwortlicher und muss – nach Abwägung – De-Referenzieren (Links entfernen). Das gilt insbesondere, wenn Angaben unzutreffend, überholt oder unverhältnismäßig sind.

Rechtsgrundlage ist Art. 17 DSGVO (Recht auf Löschung/ "Vergessenwerden"). Bei öffentlich gemachten Daten verpflichtet Abs. 2 den veröffentlichenden Verantwortlichen zu angemessenen (auch technischen) Maßnahmen und zur Information anderer Verantwortlicher über das Löschverlangen (Links/Kopien), während Abs. 3 die Ausnahmen festlegt (insbes. Meinungs-/Informationsfreiheit, bestehende Rechtsansprüche). Bei Intimfotos greift der Sonderstatus des Art. 9 DSGVO (Sexualleben). Das verschiebt die Abwägung klar zugunsten der Betroffenen und eine Auslistung ist regelmäßig geboten. Die Auslistung kann demnach nur ein überwiegendes öffentliches Interesse ausnahmsweise verdrängen (EuGH - C-136/17).

Eine globale Pflicht zur Auslistung besteht nach EuGH nicht. Gefordert ist die EU-weite De-Referenzierung, ergänzt um wirksame Maßnahmen, die die Umgehungen spürbar erschweren (EuGH - C-507/17).

2019 hat das BVerfG in Deutschland mit den Beschlüssen "Recht auf Vergessen I/II" (1 BvR 16/13 / 1 BvR 276/17) die Leitplanken der Abwägung (Persönlichkeitsrecht vs. Informationsfreiheit) nachgezeichnet und die Zuständigkeiten zwischen GG- und EU-Grundrechten präzisiert. Kurz gesagt: Geht es um Datenschutz, gilt meist EU-Recht; sonst deutsches Verfassungsrecht. Für Suchtreffer heißt das: Gerichte müssen sauber abwägen und die Anordnung so präzise formulieren, dass auch leicht veränderte Kopien mit erfasst sind.

Der Fall steht exemplarisch für bildbasierte sexualisierte Gewalt im Netz und die Frage, welche Pflichten Suchmaschinen beim Wiederauftauchen identischer oder leicht abgewandelter Inhalte treffen.

Was bedeutet "kerngleich"?

Der Begriff „kerngleich“ ist gesetzlich nicht definiert. Wir schließen uns hier dem Verständnis der HateAid FAQ an: Kerngleich sind Inhalte, die nicht pixelidentisch sind, aber denselben Sinngehalt transportieren – etwa bei anderem Zuschnitt, Spiegelung, Farbfiltern, Wasserzeichen oder minimaler Retusche:

"Kerngleichheit wäre bei einem Foto zum Beispiel dann anzunehmen, wenn es sich um dasselbe Motiv aus einer anderen Perspektive handelt oder in einem Meme verarbeitet." (HateAid-FAQ)

"Kerngleich" - Was Gerichte verlangen

Das Stichwort der Stunde lautet "kerngleicher Rechtsverstoß".

- OLG Frankfurt a.M. (OLG - 16 U 65/22): Eine Plattform muss identische und kerngleiche Varianten eines persönlichkeitsrechtsverletzenden Inhalts ohne erneuten Hinweis sperren. Reine Wortfilter reichen nicht aus und eine KI-gestütztes Verfahren kann zulässig sein. Grundlage hierfür sind die §§ 823, 1004 BGB i.V.m. Art. 1 Abs. 1, 2 Abs 1 GG; Art. 8 EMRK.

- EuGH „Glawischnig-Piesczek“ (EuGH - C-18/18): Trotz Verbots allgemeiner Überwachung dürfen Gerichte im spezifischen Fall anordnen, identische und äquivalente Inhalte zu entfernen oder zu sperren – inklusive proaktiver Suche danach.

Für Suchmaschinen gilt: Nach einem konkreten Hinweis und einer Abwägung zugunsten der betroffenen Person müssen nicht nur der gemeldete Treffer, sondern auch identische und kerngleiche Varianten zuverlässig ausgelistet werden. Diese Linie ergibt sich aus der EuGH-Rechtsprechung (Google Spain & Glawischnig) zur Verantwortlichkeit von Suchmaschinen und das fallbezogene Monitoring und der nationaler Rechtsprechung zur Kerntheorie.

Der Münchner Fall

Besonders heikel wird es, wenn Inhalte nach erfolgreicher Meldung in leicht veränderter bzw. kerngleicher Form wieder auftauchen. Genau hier setzt die Klage gegen Google an.

Streitentscheidend ist, wie weit Suchmaschinen nach einer ersten Entfernung proaktiv ähnliche Treffer identifizieren und abfangen müssen, und ob bei intimen Bildern eine gesteigerte Vorsorgepflicht besteht. Dass es sich um mutmaßlich entwendete Cloud-Aufnahmen handelt, verschiebt sich die Abwägung zusätzlich zugunsten der Betroffenen, weil eine freiwillige Öffentlichmachung fernliegt.

Der Fall kann damit Leitlinien zu „kerngleichen“ Varianten, Hash-/Ähnlichkeitserkennung und zum Zumutbarkeitsmaßstab der Filterung liefern.

Praktische Konsequenzen für Betroffene

Als erste Sofortmaßnahme sichern Betroffene Beweise, d.h. URLs, Screenshots, Zeitstempel; kurze Gedächtnisnotiz zum Auffinde-Weg. Wer sich wehren will verfolgt zwei Stränge: erstens die Quelle, zweitens die Suche.

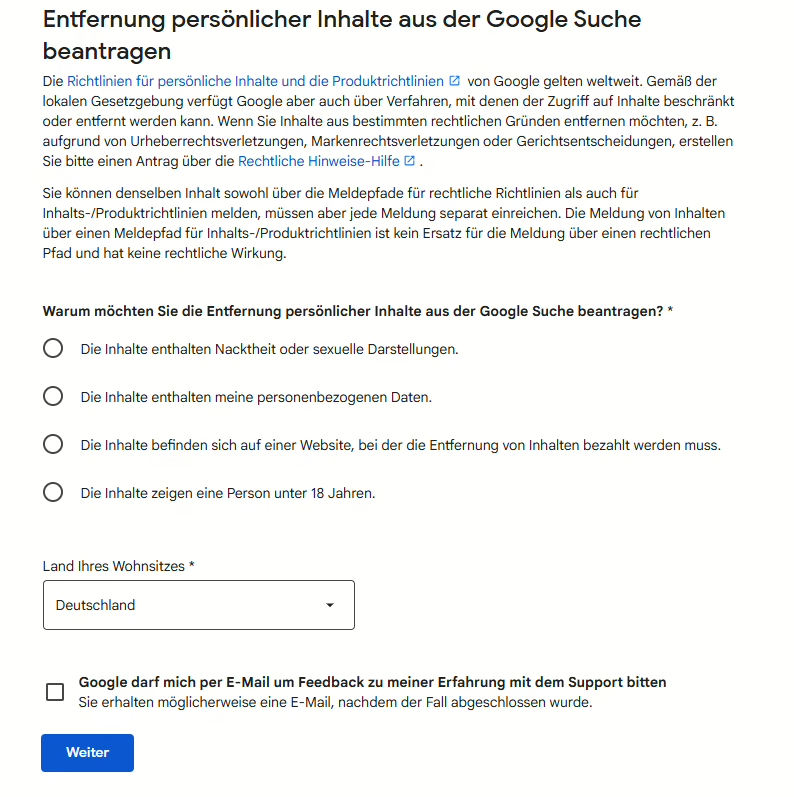

Gegen die Quelle helfen Host-Takedowns und, falls nötig, gerichtliche Unterlassung. Parallel wird bei Google die De-Referenzierung beantragt. Dafür existieren ein eigenes Formular zum Entfernen personenbezogener Ergebnisse sowie spezielle Hilfeseiten für intime Bilder oder private Inhalte.

In der Begründung des Löschbegehrens überzeugt eine klare Darstellung: keine Einwilligung, sensible Daten, fehlendes öffentliches Interesse; ergänzt um belastbare Nachweise. Die Dokumentation (URLs, Screenshots, Zeitstempel) bleibt auch für Nachmeldungen bei Re-Uploads zentral.

Gesichtssuchmaschinen (PimEyes & Co.)

Gesichtssuche funktioniert anders als die Websuche: Sie arbeitet mit biometrischen Merkmalen (Art. 9 DSGVO) und folgt eigenen Prüfmaßstäben. Was das für Betroffene und Plattformen heißt – samt konkreter Risiken – erläutern wir in einem separaten Beitrag (Link folgt).

Konsequenzen für Betroffene, Organisationen & Behörden

Organisationen brauchen feste Prozesse für Ersuchen nach Art. 17 DSGVO: klare Zuständigkeiten, Fristen, Nachweisprüfung, Abwägung und Rückmeldung. Bei sensiblen Inhalten (intime Bilder, Deepfakes) ist Priorisierung geboten.

Behörden und öffentliche Stellen profitieren von schlanken Ersthilfe-Leitfäden für Betroffene, die die duale Stoßrichtung – Quelle und Suche – nachvollziehbar erklärt und auf bewährte Anlaufstellen verweisen. Ein solcher Leitfaden enthält unter anderem einfache Beispiele, wohin die Meldung jeweils geht, welche Angaben erforderlich sind (Link, Screenshot, Kontext) und welche Fristen erfahrungsgemäß realistisch sind. Verweise auf bewährte Anlaufstellen gehören dazu, ebenso eine interne Kontaktadresse, die tatsächlich antwortet.

Vertrag statt Hoffnung: Wer Such- oder Plattformdienste einkauft, sollte Reaktions- und Löschprozesse vertraglich festschreiben - inklusive zumutbarer technischer Maßnahmen (etwa Hash-/Near-Duplicate-Erkennung für kerngleiche Varianten), EU-weiter Auslistung, dokumentierter Logging-/Monitoring-Pflichten und eines Eskalationspfads mit festen Antwortfristen. Wichtig sind außerdem ein benannter Ansprechpartner, Audit-Rechte, ein Nachweis zum False-Positive-Handling sowie klare Regeln, wie Änderungen am Filterverfahren kommuniziert werden.

Im Tagesgeschäft gilt: Jeder Vorgang erhält eine Akte mit Zeitstempeln, Entscheidungsvermerken und Belegen (Screenshots, Links, Korrespondenz). Wiederauftauchende Treffer werden der Akte zugeordnet; so lässt sich die Wiederholungsgefahr dokumentieren und eine proaktive Variantenkontrolle verlangen. Wo externe Dienstleister eingebunden sind, sollte der Vertrag eine „Fast-Lane“ für Fälle mit Art. 9-Bezug vorsehen.

Wenn es akut wird, empfiehlt sich ein abgestimmtes Vorgehen: schnelle interne Entscheidung, parallele Ansprache von Suche und Quelle, und bei weiterer Sichtbarkeit Eilrechtsschutz mit präzisem Antrag (Auslistung des Materials und seiner kerngleichen Varianten; Einsatz der vereinbarten Technik). Kommunikation nach außen bleibt knapp, sachlich, ohne Re-Traumatisierung der Betroffenen.

Kurz gesagt: Struktur schlägt Ad-hoc. Wer Prozesse, Technik und Verträge aufeinander abgestimmt hat, schützt Betroffene wirksam und kann rechtlich belastbar handeln, bevor der Schaden eskaliert.

Fazit

Das Münchner Verfahren kann zur Blaupause werden: Art. 17 DSGVO ist kein Radiergummi, aber er verpflichtet Suchmaschinen nach Erstkenntnis zu wirksamer und vorausschauender Auslistung; auch kerngleicher Varianten. Maßgeblich sind ein präziser Plan und zumutbare technische Maßnahmen (etwa Hash-/Ähnlichkeitserkennung), die Wiederauftauchen verlässlich eindämmen.

Wenn Sie betroffene sind, prüfen wir Ihren Fall und unterstützen Sie im Zusammenhang mit Ihrem Auslistungsanspruch nach Art. 17 DSGVO. Auch bei kerngleichen Re-Uploads. Das abgestimmte Vorgehen gegenüber Suchmaschine und Host koordinieren wir für Sie. Melden Sie sich über das Kontaktformular oder telefonisch bei uns!

Kerngleiche Varianten löschen: Checkliste

☐ Beweise sichern

☐ Dateien/Links sichern, nichts posten

☐ Google-Auslistung (Art. 17 DSGVO) beantragen

☐ Quelle/Host melden

☐ Wiederauftauchen dokumentieren

☐ Eilrechtsschutz prüfen

☐ Strafanzeige erwägen

oder:

☐ Rechtsberatung einholen

Hinweis: Dieser Blogbeitrag ersetzt keine Rechtsberatung.